Harari’nin Kâbusu ve Çin Örneği

Bir insan ne zaman özgür olmaktan çıkar?

Hapse girdiğinde mi?

Konuşması yasaklandığında mı?

Yoksa sokakta yürürken, internette gezinirken, alışveriş yaparken, kredi başvurusu doldururken ve hatta bisikletiyle kaldırıma çıktığında görünmez bir sistem tarafından izlenip değerlendirildiğinde mi?

Yuval Noah Harari’nin son yıllarda ısrarla sorduğu soru tam da budur.

Harari, Sapiens’te insanlığın geçmişini, Homo Deus’ta geleceğin ihtimallerini, 21. Yüzyıl İçin 21 Ders’te bugünün krizlerini, Neksus’ta ise Taş Devri’nden yapay zekâya kadar uzanan bilgi ağlarını anlattı. Onun temel meselesi şudur: İnsanlık daha fazla bilgiye sahip oldukça gerçekten daha bilge mi oluyor, yoksa kendi kurduğu bilgi ağlarının esiri mi haline geliyor? Harari’nin resmi kitap sayfası da Neksus’u, bilgi akışının dünyayı nasıl kurduğunu ve yıktığını; yapay zekâ devriminin tehdit ve vaatlerini anlamak için tarihsel bir arka plan olarak tanıtıyor.

Harari’nin Davos konuşmalarında da aynı endişe öne çıkar. 2020’de Dünya Ekonomik Forumu’nda insanlığın karşı karşıya olduğu üç büyük tehdidi sayarken nükleer savaş, ekolojik çöküş ve teknolojik kırılmadan söz etmişti. Ona göre yapay zekâ ve biyometrik gözetim birleşirse dünya “dijital diktatörlükler” ve “veri sömürgeleri” çağına girebilirdi.

2026 Davos oturumunda ise mesele daha da keskinleşti: Yapay zekâ artık yalnızca bir araç değil, öğrenebilen, ikna edebilen, içerik üretebilen, aldatabilen ve karar süreçlerine sızabilen bir “fail” haline geliyor. Harari’nin uyarısı şudur: Dil, hukuk, eğitim, finans ve siyaset gibi alanlarda yapay zekâ insanlardan daha etkili anlatılar kurmaya başlarsa, toplumun ortak gerçekliğini de şekillendirmeye başlar.

Bu yüzden Harari yapay zekâyı yalnızca “artificial intelligence”, yani yapay zekâ olarak değil; neredeyse “alien intelligence”, yani insana yabancı bir zekâ olarak düşünmemizi ister. Çünkü bu sistemler insan gibi düşünmez, insan gibi utanmaz, insan gibi vicdan azabı çekmez. Ama insanların ne okuyacağını, neye inanacağını, kime öfkeleneceğini, hangi işe alınacağını, hangi krediye erişeceğini ve hangi risk kategorisine sokulacağını etkileyebilir. Noema’daki söyleşisinde Harari, yapay zekânın önceki teknolojiler gibi pasif bir araç olmadığını; bankalarda kredi, şirketlerde işe alım, üniversitelerde kabul ve notlandırma gibi alanlarda karar süreçlerine girebileceğini vurguluyor.

İşte Harari’nin kâbusu burada başlıyor.

Bu kâbus, sokaklarda dolaşan katil robotlar değildir. Daha sessiz, daha gündelik, daha tanıdık bir tehlikedir: İnsanın, kendisi hakkında verilen kararları anlayamaz ve sorgulayamaz hale gelmesi.

Bu tehlikenin en çarpıcı örneklerinden biri Çin’de görülüyor.

Çin’de akıllı kameralar, yüz tanıma sistemleri, internet denetimi, ödeme uygulamaları, dijital kimlik altyapısı ve yapay zekâ destekli veri analizleri artık birbirinden ayrı araçlar değildir. Birlikte çalıştıklarında, insanın sokaktaki bedenini, internetteki sözünü ve ekonomik davranışını aynı ağ içinde izlenebilir hale getirirler.

Associated Press’in 2025 tarihli haberlerine göre Çin, dünyanın en büyük kamera ağlarından birine sahiptir; analistler ülkede yaklaşık iki kişiye bir kamera düşecek ölçekte bir gözetim yoğunluğundan söz etmektedir. Aynı haberlerde “Sky Net”, “Golden Shield” ve “Sharp Eyes” gibi projelerle kameraların yalnızca görüntü kaydetmediği; plaka tarama, yüz tanıma, gece görüşü ve gerçek zamanlı takip gibi işlevlerle güvenlik mimarisinin parçası haline geldiği aktarılıyor.

Fakat asıl mesele kamera sayısı değildir.

Asıl mesele kameranın akıllanmasıdır.

Eski kamera sadece kaydederdi.

Yeni kamera tanır.

Eski kamera görüntü saklardı.

Yeni kamera kimlik eşleştirir.

Eski kamera olaydan sonra izlenirdi.

Yeni kamera olay anında ceza üretebilir.

Le Monde’un 2026’da Şanghay’dan aktardığı örnek bu dönüşümün ne kadar gündelik hale geldiğini gösteriyor. Li Yan takma adını kullanan sıradan bir vatandaş, bisikletiyle kısa bir süre kaldırımdan gittiği için 50 yuan para cezası aldı. Onu hiçbir polis durdurmamıştı. Bisikletinde plaka da yoktu. Buna rağmen kamu güvenliği kameraları yüzünü otomatik olarak tanımış, kimliği belirlenmiş ve ceza mesajı telefonuna gönderilmişti. Aynı habere göre Şanghay’ın Xuhui bölgesinde yalnızca bisiklet, elektrikli bisiklet ve scooter ihlallerini tespit etmek için 120 yüz tanıma kamerası kurulmuştu.

İşte soru burada sertleşir:

Bir trafik ihlali yalnızca trafik ihlali midir?

Kâğıt üzerinde evet. Ama dijital çağda her kayıt başka bir kayda bağlanabilir. Bir yüz tanıma verisi, kimlik bilgisiyle; kimlik bilgisi ödeme alışkanlığıyla; ödeme alışkanlığı seyahat kaydıyla; seyahat kaydı mahkeme kararıyla; mahkeme kararı kredi siciliyle birleşebilir.

Çin hakkında sık yapılan bir yanlış var: Her yurttaşa tek bir merkezi “sosyal kredi puanı” verildiğini ve bu puanın her davranışla otomatik yükselip düştüğünü söylemek meseleyi basitleştirir. Daha doğru tablo, farklı kurumların tuttuğu kara listeler, idari kayıtlar, mahkeme kararları, finansal veriler ve yerel uygulamalardan oluşan parçalı ama etkili bir sistemdir.

Bu parçalı sistemin tehlikesi daha az değil, belki daha fazladır. Çünkü kişi çoğu zaman hangi kaydın nerede tutulduğunu, hangi kurumla paylaşıldığını ve ileride hangi kapıyı kapatacağını bilemez.

Çin’de “güvenilmezlik” yaptırımlarına ilişkin 2024 tarihli temel ceza listesinde piyasa veya sektörlere giriş kısıtlaması, belirli görevlerde bulunma engeli, harcama sınırlamaları, ülkeden çıkış kısıtlaması, eğitim basamaklarına erişim sınırlaması, kamu fonlarına başvuru kısıtı ve kredi raporlarına olumsuz bilgi eklenmesi gibi tedbirler yer alabiliyor.

Mahkeme kararlarını yerine getirmeyen kişiler için de ciddi kısıtlamalar söz konusu. Çin Yüksek Halk Mahkemesi düzenlemelerine göre bazı borçluların uçakla seyahat etmesi, hızlı trenlerde belirli koltukları kullanması, lüks otellerde kalması, gayrimenkul satın alması, yüksek harcamalı tatillere çıkması, çocuklarını pahalı özel okullara göndermesi veya bazı finansal ürünlere yatırım yapması sınırlandırılabiliyor.

Bu noktada dikkatli olmak gerekir: Basit bir trafik cezası otomatik olarak “iş bulamazsın, kredi çekemezsin, seyahat edemezsin” sonucunu doğurur demek doğru değildir. Fakat sistemin mantığı şudur: Davranış kayda girer. Kayıt sınıflandırılır. Sınıflandırma başka alanlarda sonuç üretebilir. Bir insanın gündelik hatası, dijital sicilinin parçası haline gelebilir.

Harari’nin korkusu tam burada ete kemiğe bürünür.

Yapay zekâ insanı yalnızca işsiz bıraktığı için tehdit etmez.

Yapay zekâ insanı yalnızca yanlış bilgi ürettiği için tehdit etmez.

Yapay zekâ insanı yalnızca mahremiyetini yok ettiği için tehdit etmez.

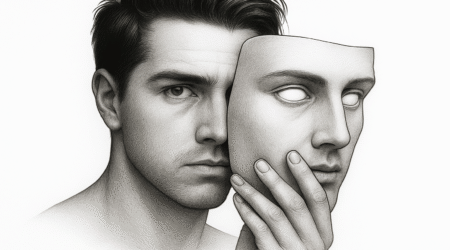

En büyük tehdit, insanı tanımlama gücünü ele geçirmesidir.

Kim güvenilir?

Kim riskli?

Kim izlenmeli?

Kim kredi alabilir?

Kim işe uygun?

Kim sisteme aykırı?

Kim “iyi vatandaş”?

Bu sorulara artık yalnızca insanlar değil, algoritmalar da cevap vermeye başladığında insanın özgürlüğü yeni bir baskı biçimiyle karşılaşır.

Bu baskı kaba kuvvetle gelmez.

Çoğu zaman kolaylık vaadiyle gelir.

Güvenlik der.

Verimlilik der.

Kamu düzeni der.

Hızlı hizmet der.

Kişiselleştirilmiş deneyim der.

Sonra bir gün insan fark eder ki, özgürce yaşamıyor; sistemin kendisini nasıl değerlendireceğini düşünerek yaşıyor.

Kameranın önünde daha dikkatli yürür.

Telefonda daha temkinli konuşur.

İnternette daha ölçülü yazar.

Yanlış anlaşılmamak için susar.

Bir süre sonra sansür dışarıdan gelmez; insanın içine yerleşir.

Çin örneği bu yüzden yalnızca Çin’in meselesi değildir. Dünyanın birçok yerinde devletler güvenlik, şirketler hizmet kalitesi, platformlar kullanıcı deneyimi, bankalar risk analizi, işverenler verimlilik adına daha fazla veri istiyor. Herkes biraz daha görmek, biraz daha bilmek, biraz daha tahmin etmek istiyor.

Peki insanın görünmeden kalma hakkı ne olacak?

Yanılma hakkı ne olacak?

Unutulma hakkı ne olacak?

İtiraz hakkı ne olacak?

Bir algoritmanın karşısında kendini savunma hakkı ne olacak?

Harari’nin Neksus’ta anlattığı bilgi ağları meselesi burada güncel bir uyarıya dönüşür: Bilgi yalnızca aydınlatmaz; bazen gözetler. Yapay zekâ yalnızca üretmez; bazen yönetir. İnternet yalnızca bağlamaz; bazen insanı sınıflandırır. Akıllı kamera yalnızca güvenlik sağlamaz; bazen özgürlüğün sınırlarını çizer.

Bugünün en büyük sorusu artık “Yapay zekâ ne kadar zeki olacak?” değildir.

Asıl soru şudur:

İnsan hâlâ özne mi, yoksa akıllı ağların içinde izlenen, puanlanan ve yönetilen bir veri parçası mı?

Bir yanıt yazın